(短片)演算法的實際運用及其新興風險:同溫層

講座系列

人工智慧法律系列

講座進程

已開課

講座日期

2019-07-31

講座地點

理律文教基金會

單位與講者

- .主辦單位:財團法人理律文教基金會

- 、 國立政治大學法學院

- .主講人:

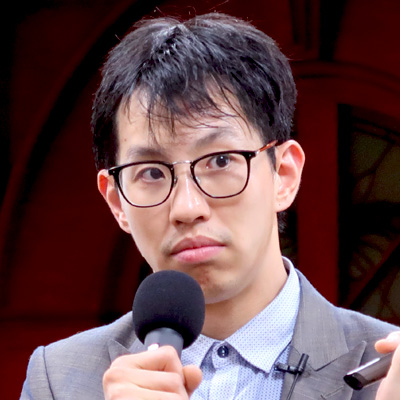

- 陳奕甫

- 經理

講座介紹

人工智慧AI存有以下潛在風險:未來無隱私、無自主權、資訊壟斷、資源分配不均、造成社會疏離,先要理解風險本質才能真正進行管理,因而全面認識演算法才能妥善以法律或道德自律形成治理框架;當演算法黑盒在所難免時,則應透過黑盒探針、控制黑盒走向、利用建議模組(Adversary network)預判比對是否符合初始期望等方法打造「可被解釋的人工智慧」(Explained-AI)。

實際上演算法已深入捕捉我們各項資訊,從每天網路搜尋、社群平台表情貼文、雲端音樂播放、App排行,在網路世界的日常生活一舉一動,藉由資料累積庫存(inventory)、篩選訊號(signals)、進一步預測(predictions)用戶喜好興趣、再權重衡量產生分數(score)來決定資訊出現先後順序,無形中接收的資訊已被過濾、身處看似越來越厚實的同溫層;同時,演算法本身存在的缺陷(如資料不全、歧視偏見等)可能損害其應用產生的決策、預測與分析結果,引發或加劇目前道德、技術、法律或其他方面的困境。

財團法人理律文教基金會著作權所有,非經同意不得翻印轉載或以任何方式重製.

© Lee and Li Foundation., All rights reserved.

Tel: +886- 2-2760-6111 / Fax: +886-2-2756-5111

E-mail: [email protected]